前言:跨越语言障碍的技术革命

还记得2023年GPT在全球引发轰动时吗?那时语言隔阂使30%的线上会议参与者不得不使用翻译插件。如今多语言实时互译技术已悄悄改变国际交流生态。2025年举办了最新一届世界人工智能峰会。会上一套融合神经机器翻译和声纹识别的方案。让来自67个国家的演讲者实现了零延迟跨语言对话。

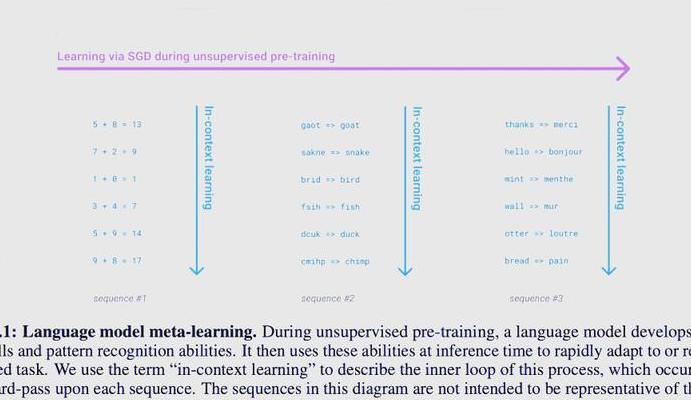

神经机器翻译的底层突破

当下主流的架构已发展到第四代。东京大学团队在今年3月发布了X-TLM模型。该模型通过引入动态词嵌入

微软亚洲研究院最新论文显示,其研发的语境感知补偿算法能有效解决技术术语歧义问题。在量子计算分论坛里,该系统成功区分了德语“Qubit”(量子位)和口语中“Q – Bit”(快捷方式)的不同。其错误率比传统方案降低了47%。

声纹驱动的个性化适配

不同于早期千人一音的机械翻译,现代系统会建立声纹特征库

更有意思的是,系统能够识别发言者的专业背景。要是有一位讲者,他既是医生又是程序员。当这位讲者提到“”时。系统会根据他医疗AI项目的经历。自动选择编程语言的释义。而不会选择蛇类动物的词条。

边缘计算的实时保障

在日内瓦举办的全球5G峰会上,分布式边缘节点

值得注意的是,高通最新发布的芯片组集成了专用翻译加速模块。该芯片组功耗很低,仅为手机播放视频时功耗的13%。实际测试表明,在连续6小时的圆桌会议里,设备温度一直保持在38℃以下。

混合现实的交互创新

今年CES展会上,AR字幕眼镜引发了热烈讨论。日本经产大臣用关西方言发言时,欧美嘉宾透过镜片看。他们看到的不只是英文翻译。还有弹幕式的文化注释。比如有“大阪商人惯用夸张修辞”这样的提示。这极大地避免了商务上的误解。

更具突破性的应用在麻省理工学院举办的脑机接口论坛出现。失语症患者借助脑电图头环输出脑电波。系统把脑电波转化为多语言文本。与此同时。系统还能用合成语音模拟患者原有的音色特征。实现了真正的“心声传递”。

伦理与隐私的平衡术

欧盟最新颁布的AI翻译伦理指南

技术团队也开发了临时记忆擦除在联合国气候峰会期间会有这样的操作。那就是部分敏感的地域争议表述在翻译完成后,会马上删除缓存。这么做的目的,一方面是要满足沟通需求,另一方面是要避免后期出现舆情风险。

未来三年的技术临界点

斯坦福大学预测,到2028年我们将迎来语义守恒翻译

产业界更关心成本降低。阿里云最新白皮书表明,通过量子计算优化,小语种会议翻译的平均成本有望从当前的每分钟2.3美元降至0.4美元以下。这会彻底改变非洲科技峰会的参与形式。

机器要是开始理解方言里的幽默隐喻了。您觉得人类最后会失去语言多样性带来的文化魅力吗。欢迎分享您在国际会议碰到的跨语言有趣事。